Las expresiones regulares, conocidas como regex, son patrones utilizados para buscar coincidencias dentro de cadenas de texto. Aunque su apariencia pueda parecer intimidante al principio, dominar regex puede marcar una gran diferencia en la eficacia de tareas SEO técnicas, analíticas y de automatización.

A lo largo de esta guía exploraremos qué son, cómo funcionan, y cómo se pueden aplicar en distintas herramientas SEO.

Una herramienta muy útil para probar expresiones regulares es:

🔗 https://regex101.com/

1. ¿Qué son las expresiones regulares?

Una expresión regular es una secuencia de caracteres que define un patrón de búsqueda. Se utilizan para identificar cadenas específicas de texto dentro de grandes volúmenes de datos.

Por ejemplo, podrías usar regex para encontrar todas las URLs de un sitio que contengan /blog/, o extraer los IDs numéricos de un listado de productos.

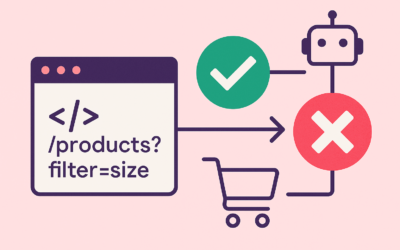

2. ¿Por qué son útiles en SEO?

Las expresiones regulares permiten trabajar de forma más eficiente y precisa con:

URLs

Parámetros

Estructuras de contenido

Encabezados

Redirecciones

En tareas como:

Auditorías técnicas

Análisis de logs

Filtros en Search Console

Configuración de robots.txt y htaccess

Segmentación en Google Analytics

Gracias a su versatilidad, se han convertido en una habilidad muy valiosa para SEOs técnicos y analistas de datos.

3. Conceptos básicos que debes entender antes de usar regex

Antes de usar expresiones regulares, conviene tener claras algunas ideas clave:

Las regex distinguen entre mayúsculas y minúsculas, salvo que se indique lo contrario.

Cada carácter puede tener un significado especial, por lo que algunos deben «escaparse» con una barra invertida (\), como el punto (\.).

Se trabaja por patrones: no buscan texto exacto, sino coincidencias estructurales.

Suelen evaluarse en herramientas que permiten usar modo regex (como GSC, Screaming Frog, Google Sheets, etc.).

4. Cómo empezar a usar regex

La forma más fácil de empezar es:

- Abrir regex101.com

- Escribir un texto de prueba (por ejemplo, una lista de URLs)

- Ir probando patrones simples (como ^/blog/ o \.html$)

- Usar la explicación interactiva que ofrece la herramienta

A partir de ahí, puedes pasar a aplicarlas en entornos reales como Google Search Console o Google Sheets.

5. Buenas prácticas al usar regex en SEO

Escapa siempre los caracteres especiales cuando los uses como texto literal (., /, ?, etc.).

Empieza por patrones simples y ve añadiendo complejidad poco a poco.

Comprueba tus patrones antes de aplicarlos en herramientas sensibles como .htaccess.

Documenta tus regex si las vas a compartir o reutilizar en equipo.

6. Ejemplos sencillos para empezar

Aquí algunos patrones básicos:

| Objetivo | Expresión Regex |

| URLs que terminan en .html | \.html$ |

| URLs que empiezan por /blog/ | ^/blog/ |

| URLs con números | \d+ |

| Cadenas que no terminan en / | [^/]$ |

| Coincidencia con http o https | ^https?:// |

Estos patrones pueden combinarse, modificarse y aplicarse a necesidades mucho más complejas.

7. Dónde se utilizan las expresiones regulares en SEO

Las expresiones regulares pueden aplicarse en múltiples entornos dentro del trabajo SEO:

🗂 Archivos

robots.txt: para bloquear o permitir ciertas rutas mediante patrones.

.htaccess: para redirecciones o reescrituras de URLs mediante mod_rewrite.

🔍 Herramientas de análisis

Google Search Console: para filtrar resultados por URLs.

Google Analytics: para crear segmentos avanzados.

Screaming Frog: para extraer datos como precios o migas de pan.

Google Sheets: para automatizar tareas de limpieza, extracción o transformación de datos.

7.1 Elementos más relevantes de las expresiones regulares

A continuación se presenta una tabla con algunos elementos importantes en lo que se refiere a las REGEX:

| Categoría | Símbolo o Ejemplo | Descripción |

|---|---|---|

| A) Anclas y límites | ^ | Inicio de cadena |

| $ | Fin de cadena | |

| B) Caracteres | . | Cualquier carácter excepto salto de línea |

| \. | Punto literal | |

| \d | Dígito entre 0 y 9 | |

| \D | No es un dígito | |

| \w | Carácter de palabra (letra, número o guion bajo) | |

| \W | No es carácter de palabra | |

| \s | Espacio en blanco, tabulación o salto de línea | |

| \S | Cualquier cosa que no sea espacio | |

| C) Cuantificadores | * | Cero o más apariciones |

| ? | Cero o una aparición del carácter anterior | |

| + | Una o más apariciones | |

| {n} | Exactamente n repeticiones | |

| {n,} | Al menos n repeticiones | |

| {n,m} | Entre n y m repeticiones | |

| D) Operadores | | | OR lógico (alternancia) |

| (…) | Grupo de captura | |

| E) Clases de caracteres | [abc] | Uno de los caracteres especificados |

| [a-z] | Cualquier carácter entre «a» y «z» | |

| [^x] | Cualquier carácter que no sea «x» | |

| [^x-y] | Cualquier carácter que no esté entre «x» y «y» | |

| Nota | Dentro de [], ^ niega el conjunto, no indica inicio |

|

| F) Espacios | \s, \t, \n | Espacio, tabulador, salto de línea |

| G) Modificadores | g | Coincidencia global |

| i | Ignora mayúsculas/minúsculas | |

| m | Modo multilínea (interpreta ^ y $ en cada línea) | |

7.2 – Algunos Ejemplos REGEX

7.2.1 – Frecuencia que Googlebot visita una URL concreta

Para analizar esto, se pueden usar los logs del servidor y aplicar expresiones regulares sobre ellos. Por ejemplo:

Googlebot.*\/mi-url-especifica

Este patrón localiza accesos de Googlebot a una URL determinada. Luego se cuentan las coincidencias para obtener la frecuencia de rastreo.

7.2.2 – Cuántas veces se repite un criterio o encabezado

Para contar encabezados (H1, H2, H3) dentro del HTML de una página:

<h[1-3]>.*?<\/h[1-3]>

Este patrón encuentra todas las etiquetas H1, H2 y H3, útil para auditorías de contenido y comprobar si hay encabezados duplicados.

7.2.3 – Redirección desde /es/ a la versión sin idioma

RedirectMatch 301 ^/es/(.*) /$1

Esto elimina el prefijo /es/ de las URLs, redirigiendo a la misma ruta sin el idioma. Muy útil en proyectos multilingües que han decidido eliminar el prefijo de idioma.

7.2.4 – Rastrear o bloquear URLs con determinada profundidad

Para detectar URLs con profundidad de 4 niveles:

/*/*/*/*

En Screaming Frog se puede usar para limitar el análisis, y en robots.txt para bloquear ciertos directorios demasiado profundos.

7.2.5 – URLs que pertenecen a determinada categoría

\/.*\/10-calzado-laboral\/.*

Coincide con cualquier URL que contenga /10-calzado-laboral/, útil para aislar categorías específicas.

7.2.6 – URL del tipo proyecto-de-[loquesea].html

proyecto-de-[^\/]+\.html$

Coincide con URLs como proyecto-de-clientes.html, capturando cualquier valor tras «proyecto-de-» que no contenga /.

8 – REGEX en Google Search Console

Al trabajar con filtros personalizados, hay que escapar ciertos caracteres especiales. Por ejemplo, para ver las URLs de “pantallas LED” en GSC:

https:\/\/www\.rotuloselectronicos\.net\/pantallas-led.*

Escapar /, . y : es obligatorio.

9 – REGEX en Google Sheets

Google Sheets ofrece funciones que permiten aplicar regex sobre columnas de texto:

REGEXMATCH(texto, regex)

Devuelve TRUE o FALSE si hay coincidencia.

=REGEXMATCH(A2, «cruz|cruces|farmacia»)

REGEXREPLACE(texto, regex, reemplazo)

Reemplaza coincidencias por otro texto.

=REGEXREPLACE(A2, «sexis|sensuales», «eróticas»)

REGEXEXTRACT(texto, regex)

Extrae fragmentos capturados.

=REGEXEXTRACT(A2, «^\/[^/]+\/([^/]+)\/$»)

Para extraer un valor, debe ir entre paréntesis ( ) dentro del patrón.

10 – REGEX en Screaming Frog

Screaming Frog permite aplicar regex para:

Extraer valores de migas de pan (breadcrumb).

Detectar encabezados repetidos.

Filtrar URLs por nivel:

^\/[^\/]+\/[^\/]+\/[^\/]+\/$

11 – REGEX en .htaccess

Redirección de HTTP a HTTPS

RewriteEngine on

RewriteCond %{HTTPS} !=on

RewriteRule ^(.*)$ https://www.midominio.com/$1 [R=301,L]

Transformación de URLs amigables

RewriteRule ^producto/([0-9]+)$ producto.php?id=$1

El módulo mod_rewrite permite estas configuraciones directamente en el .htaccess.

Conclusión

Dominar las expresiones regulares te da una ventaja significativa en el mundo del SEO. Te permiten automatizar tareas, filtrar grandes volúmenes de información y adaptar estructuras complejas. Desde Search Console hasta Screaming Frog, pasando por Analytics, hojas de cálculo o archivos de configuración, las regex están en todas partes.

💡 Recurso recomendado:

regex101.com para probar, depurar y entender patrones de forma visual.